Por Aryadny Silva

Articulista que escreve às quartas-feiras

Vivemos em uma era em que a tecnologia avança rapidamente, e a capacidade humana de acompanhar suas consequências parece insuficiente. Entre as inovações mais poderosas e controversas está a Inteligência Artificial (IA). Ela oferece soluções extraordinárias para áreas como medicina, educação e sustentabilidade, mas também representa um desafio ético e social sem precedentes. Nenhum campo sente tanto esse impacto quanto o da política e das eleições democráticas.

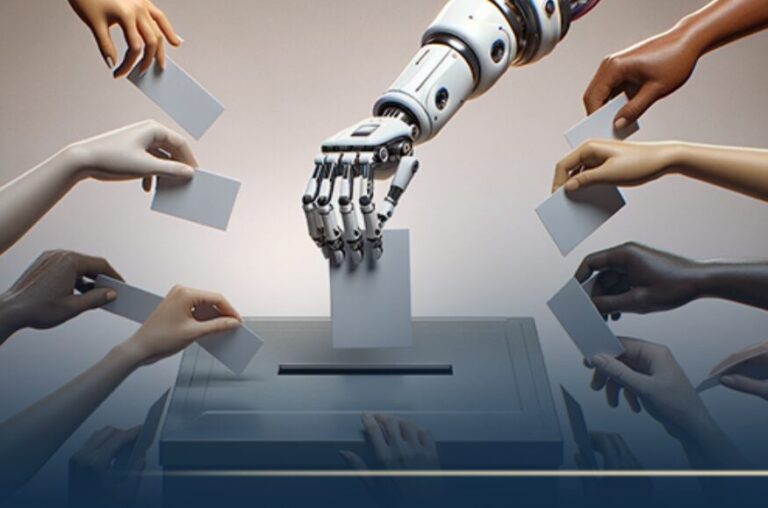

A IA transformou a forma como produzimos e consumimos informação. Ferramentas capazes de criar textos, imagens, vídeos e vozes sintéticas, muitas vezes idênticas à realidade, permitem a disseminação de conteúdos falsos com aparência de verdade. Isso amplia o alcance da desinformação em níveis nunca vistos. Nas redes sociais, onde a atenção é o novo ouro, algoritmos que buscam engajamento priorizam o que causa choque, emoção ou divisão. O resultado é um ambiente propício a fake news, deepfakes e manipulações ideológicas, com impacto direto sobre a opinião pública e o voto. A IA, nesse contexto, não é apenas uma ferramenta, mas uma arma política.

As eleições são o pilar da democracia, mas sua integridade depende de um fator essencial: a confiança. Quando vídeos falsos, discursos gerados por máquinas e perfis automatizados são usados para confundir eleitores ou destruir reputações, essa confiança se abala. Nas próximas eleições, o risco de interferência digital automatizada é real. Sistemas de IA podem segmentar eleitores com precisão, explorando seus medos e crenças por meio de campanhas personalizadas e manipuladoras. O eleitor, acreditando estar tomando uma decisão livre e informada, pode estar apenas reagindo a estímulos criados por um algoritmo.

Diante desse cenário, o debate ético é urgente. Quem é responsável quando uma IA espalha desinformação? O desenvolvedor, o usuário ou a plataforma? Ainda não há consenso jurídico, e a falta de regulamentação eficaz torna o ambiente digital perigoso. Governos e instituições precisam investir em educação midiática, verificação de fatos e transparência algorítmica. É essencial que os cidadãos aprendam a reconhecer sinais de manipulação digital e que a legislação acompanhe o ritmo das inovações tecnológicas. Além disso, as empresas que desenvolvem IA devem assumir compromissos éticos claros, garantindo que suas tecnologias não ameacem processos democráticos.

A responsabilidade é compartilhada, mas o poder final ainda está nas mãos de cada um. A IA pode influenciar, mas não pode votar. Cabe ao cidadão buscar fontes confiáveis, questionar conteúdos duvidosos e refletir antes de compartilhar qualquer informação. A consciência crítica será o maior escudo contra a manipulação tecnológica.

A Inteligência Artificial é uma das maiores conquistas da humanidade, mas também um dos seus maiores riscos. O futuro da democracia dependerá da forma como usamos essa tecnologia: com responsabilidade, ética e consciência coletiva.

[*] Ativista social e defensora dos direitos humanos